English | 简体中文 | 繁體中文 | 한국어 | Español | 日本語 | हिन्दी | Русский | Рortuguês | తెలుగు | Français | Deutsch | Tiếng Việt |

🤗 Transformers fournit des milliers de modèles pré-entraînés pour effectuer des tâches sur différentes modalités telles que le texte, la vision et l'audio.

Ces modèles peuvent être appliqués à :

- 📝 Texte, pour des tâches telles que la classification de texte, l'extraction d'informations, la réponse aux questions, le résumé, la traduction et la génération de texte, dans plus de 100 langues.

- 🖼️ Images, pour des tâches telles que la classification d'images, la détection d'objets et la segmentation.

- 🗣️ Audio, pour des tâches telles que la reconnaissance vocale et la classification audio.

Les modèles de transformer peuvent également effectuer des tâches sur plusieurs modalités combinées, telles que la réponse aux questions sur des tableaux, la reconnaissance optique de caractères, l'extraction d'informations à partir de documents numérisés, la classification vidéo et la réponse aux questions visuelles.

🤗 Transformers fournit des API pour télécharger et utiliser rapidement ces modèles pré-entraînés sur un texte donné, les affiner sur vos propres ensembles de données, puis les partager avec la communauté sur notre hub de modèles. En même temps, chaque module Python définissant une architecture est complètement indépendant et peut être modifié pour permettre des expériences de recherche rapides.

🤗 Transformers est soutenu par les trois bibliothèques d'apprentissage profond les plus populaires — Jax, PyTorch et TensorFlow — avec une intégration transparente entre eux. Il est facile de former vos modèles avec l'un avant de les charger pour l'inférence avec l'autre.

Vous pouvez tester la plupart de nos modèles directement sur leurs pages du hub de modèles. Nous proposons également l'hébergement privé de modèles, le versionning et une API d'inférence pour des modèles publics et privés.

Voici quelques exemples :

En traitement du langage naturel :

- Complétion de mots masqués avec BERT

- Reconnaissance d'entités nommées avec Electra

- Génération de texte avec GPT-2

- Inférence de langage naturel avec RoBERTa

- Résumé avec BART

- Réponse aux questions avec DistilBERT

- Traduction avec T5

En vision par ordinateur :

- Classification d'images avec ViT

- Détection d'objets avec DETR

- Segmentation sémantique avec SegFormer

- Segmentation panoptique avec MaskFormer

- Estimation de profondeur avec DPT

- Classification vidéo avec VideoMAE

- Segmentation universelle avec OneFormer

En audio :

- Reconnaissance automatique de la parole avec Wav2Vec2

- Spotting de mots-clés avec Wav2Vec2

- Classification audio avec Audio Spectrogram Transformer

Dans les tâches multimodales :

- Réponses aux questions sur table avec TAPAS

- Réponses aux questions visuelles avec ViLT

- Classification d'images sans étiquette avec CLIP

- Réponses aux questions sur les documents avec LayoutLM

- Classification vidéo sans étiquette avec X-CLIP

Transformers est plus qu'une boîte à outils pour utiliser des modèles pré-entraînés : c'est une communauté de projets construits autour de lui et du Hub Hugging Face. Nous voulons que Transformers permette aux développeurs, chercheurs, étudiants, professeurs, ingénieurs et à quiconque d'imaginer et de réaliser leurs projets de rêve.

Afin de célébrer les 100 000 étoiles de transformers, nous avons décidé de mettre en avant la communauté et avons créé la page awesome-transformers qui répertorie 100 projets incroyables construits autour de transformers.

Si vous possédez ou utilisez un projet que vous pensez devoir figurer dans la liste, veuillez ouvrir une pull request pour l'ajouter !

Pour utiliser immédiatement un modèle sur une entrée donnée (texte, image, audio,...), nous fournissons l'API pipeline. Les pipelines regroupent un modèle pré-entraîné avec la préparation des données qui a été utilisée lors de l'entraînement de ce modèle. Voici comment utiliser rapidement un pipeline pour classer des textes en positif ou négatif :

>>> from transformers import pipeline

# Allouer un pipeline pour l'analyse de sentiment

>>> classifieur = pipeline('sentiment-analysis')

>>> classifieur('Nous sommes très heureux d'introduire le pipeline dans le référentiel transformers.')

[{'label': 'POSITIF', 'score': 0.9996980428695679}]La deuxième ligne de code télécharge et met en cache le modèle pré-entraîné utilisé par le pipeline, tandis que la troisième l'évalue sur le texte donné. Ici, la réponse est "positive" avec une confiance de 99,97%.

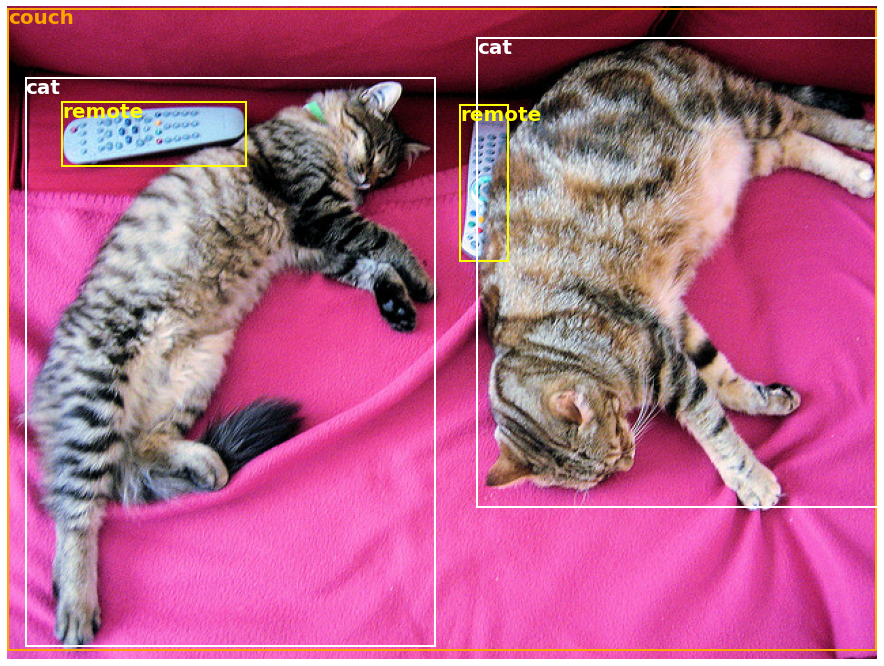

De nombreuses tâches ont une pipeline pré-entraîné prêt à l'emploi, en NLP, mais aussi en vision par ordinateur et en parole. Par exemple, nous pouvons facilement extraire les objets détectés dans une image :

>>> import requests

>>> from PIL import Image

>>> from transformers import pipeline

# Télécharger une image avec de jolis chats

>>> url = "https://huggingface.co/datasets/huggingface/documentation-images/resolve/main/coco_sample.png"

>>> donnees_image = requests.get(url, stream=True).raw

>>> image = Image.open(donnees_image)

# Allouer un pipeline pour la détection d'objets

>>> detecteur_objets = pipeline('object-detection')

>>> detecteur_objets(image)

[{'score': 0.9982201457023621,

'label': 'télécommande',

'box': {'xmin': 40, 'ymin': 70, 'xmax': 175, 'ymax': 117}},

{'score': 0.9960021376609802,

'label': 'télécommande',

'box': {'xmin': 333, 'ymin': 72, 'xmax': 368, 'ymax': 187}},

{'score': 0.9954745173454285,

'label': 'canapé',

'box': {'xmin': 0, 'ymin': 1, 'xmax': 639, 'ymax': 473}},

{'score': 0.9988006353378296,

'label': 'chat',

'box': {'xmin': 13, 'ymin': 52, 'xmax': 314, 'ymax': 470}},

{'score': 0.9986783862113953,

'label': 'chat',

'box': {'xmin': 345, 'ymin': 23, 'xmax': 640, 'ymax': 368}}]Ici, nous obtenons une liste d'objets détectés dans l'image, avec une boîte entourant l'objet et un score de confiance. Voici l'image originale à gauche, avec les prédictions affichées à droite :

Vous pouvez en savoir plus sur les tâches supportées par l'API pipeline dans ce tutoriel.

En plus de pipeline, pour télécharger et utiliser n'importe lequel des modèles pré-entraînés sur votre tâche donnée, il suffit de trois lignes de code. Voici la version PyTorch :

>>> from transformers import AutoTokenizer, AutoModel

>>> tokenizer = AutoTokenizer.from_pretrained("google-bert/bert-base-uncased")

>>> model = AutoModel.from_pretrained("google-bert/bert-base-uncased")

inputs = tokenizer("Bonjour le monde !", return_tensors="pt")

outputs = model(**inputs)Et voici le code équivalent pour TensorFlow :

from transformers import AutoTokenizer, TFAutoModel

tokenizer = AutoTokenizer.from_pretrained("google-bert/bert-base-uncased")

model = TFAutoModel.from_pretrained("google-bert/bert-base-uncased")

inputs = tokenizer("Bonjour le monde !", return_tensors="tf")

outputs = model(**inputs)Le tokenizer est responsable de toutes les étapes de prétraitement que le modèle préentraîné attend et peut être appelé directement sur une seule chaîne de caractères (comme dans les exemples ci-dessus) ou sur une liste. Il produira un dictionnaire que vous pouvez utiliser dans votre code ou simplement passer directement à votre modèle en utilisant l'opérateur de déballage **.

Le modèle lui-même est un module nn.Module PyTorch ou un modèle tf.keras.Model TensorFlow (selon votre backend) que vous pouvez utiliser comme d'habitude. Ce tutoriel explique comment intégrer un tel modèle dans une boucle d'entraînement classique PyTorch ou TensorFlow, ou comment utiliser notre API Trainer pour affiner rapidement sur un nouvel ensemble de données.

-

Des modèles de pointe faciles à utiliser :

- Hautes performances en compréhension et génération de langage naturel, en vision par ordinateur et en tâches audio.

- Faible barrière à l'entrée pour les éducateurs et les praticiens.

- Peu d'abstractions visibles pour l'utilisateur avec seulement trois classes à apprendre.

- Une API unifiée pour utiliser tous nos modèles préentraînés.

-

Coûts informatiques réduits, empreinte carbone plus petite :

- Les chercheurs peuvent partager des modèles entraînés au lieu de toujours les réentraîner.

- Les praticiens peuvent réduire le temps de calcul et les coûts de production.

- Des dizaines d'architectures avec plus de 400 000 modèles préentraînés dans toutes les modalités.

-

Choisissez le bon framework pour chaque partie de la vie d'un modèle :

- Entraînez des modèles de pointe en 3 lignes de code.

- Trasnférer un seul modèle entre les frameworks TF2.0/PyTorch/JAX à volonté.

- Choisissez facilement le bon framework pour l'entraînement, l'évaluation et la production.

-

Personnalisez facilement un modèle ou un exemple selon vos besoins :

- Nous fournissons des exemples pour chaque architecture afin de reproduire les résultats publiés par ses auteurs originaux.

- Les détails internes du modèle sont exposés de manière aussi cohérente que possible.

- Les fichiers de modèle peuvent être utilisés indépendamment de la bibliothèque pour des expériences rapides.

- Cette bibliothèque n'est pas une boîte à outils modulaire de blocs de construction pour les réseaux neuronaux. Le code dans les fichiers de modèle n'est pas refactored avec des abstractions supplémentaires à dessein, afin que les chercheurs puissent itérer rapidement sur chacun des modèles sans plonger dans des abstractions/fichiers supplémentaires.

- L'API d'entraînement n'est pas destinée à fonctionner avec n'importe quel modèle, mais elle est optimisée pour fonctionner avec les modèles fournis par la bibliothèque. Pour des boucles génériques d'apprentissage automatique, vous devriez utiliser une autre bibliothèque (éventuellement, Accelerate).

- Bien que nous nous efforcions de présenter autant de cas d'utilisation que possible, les scripts de notre dossier d'exemples ne sont que cela : des exemples. Il est prévu qu'ils ne fonctionnent pas immédiatement sur votre problème spécifique et que vous devrez probablement modifier quelques lignes de code pour les adapter à vos besoins.

Ce référentiel est testé sur Python 3.8+, Flax 0.4.1+, PyTorch 1.11+ et TensorFlow 2.6+.

Vous devriez installer 🤗 Transformers dans un environnement virtuel. Si vous n'êtes pas familier avec les environnements virtuels Python, consultez le guide utilisateur.

D'abord, créez un environnement virtuel avec la version de Python que vous allez utiliser et activez-le.

Ensuite, vous devrez installer au moins l'un de Flax, PyTorch ou TensorFlow. Veuillez vous référer à la page d'installation de TensorFlow, de PyTorch et/ou de Flax et Jax pour connaître la commande d'installation spécifique à votre plateforme.

Lorsqu'un de ces backends est installé, 🤗 Transformers peut être installé avec pip comme suit :

pip install transformersSi vous souhaitez jouer avec les exemples ou avez besoin de la dernière version du code et ne pouvez pas attendre une nouvelle version, vous devez installer la bibliothèque à partir de la source.

🤗 Transformers peut être installé avec conda comme suit :

conda install conda-forge::transformersNOTE: L'installation de

transformersdepuis le canalhuggingfaceest obsolète.

Suivez les pages d'installation de Flax, PyTorch ou TensorFlow pour voir comment les installer avec conda.

NOTE: Sur Windows, on peut vous demander d'activer le mode développeur pour bénéficier de la mise en cache. Si ce n'est pas une option pour vous, veuillez nous le faire savoir dans cette issue.

Tous les points de contrôle de modèle fournis par 🤗 Transformers sont intégrés de manière transparente depuis le hub de modèles huggingface.co, où ils sont téléchargés directement par les utilisateurs et les organisations.

Nombre actuel de points de contrôle :

🤗 Transformers fournit actuellement les architectures suivantes (consultez ici pour un résumé global de chacune d'entre elles) :

- ALBERT (de Google Research et du Toyota Technological Institute at Chicago) publié dans l'article ALBERT: A Lite BERT for Self-supervised Learning of Language Representations, par Zhenzhong Lan, Mingda Chen, Sebastian Goodman, Kevin Gimpel, Piyush Sharma, Radu Soricut.

- ALIGN (de Google Research) publié dans l'article Scaling Up Visual and Vision-Language Representation Learning With Noisy Text Supervision de Chao Jia, Yinfei Yang, Ye Xia, Yi-Ting Chen, Zarana Parekh, Hieu Pham, Quoc V. Le, Yunhsuan Sung, Zhen Li, Tom Duerig.

- AltCLIP (de BAAI) publié dans l'article AltCLIP: Altering the Language Encoder in CLIP for Extended Language Capabilities de Chen, Zhongzhi et Liu, Guang et Zhang, Bo-Wen et Ye, Fulong et Yang, Qinghong et Wu, Ledell.

- Audio Spectrogram Transformer (du MIT) publié dans l'article AST: Audio Spectrogram Transformer de Yuan Gong, Yu-An Chung, James Glass.

- Autoformer (de l'Université Tsinghua) publié dans l'article Autoformer: Decomposition Transformers with Auto-Correlation for Long-Term Series Forecasting de Haixu Wu, Jiehui Xu, Jianmin Wang, Mingsheng Long.

- Bark (de Suno) publié dans le référentiel suno-ai/bark par l'équipe Suno AI.

- BART (de Facebook) publié dans l'article BART: Denoising Sequence-to-Sequence Pre-training for Natural Language Generation, Translation, and Comprehension de Mike Lewis, Yinhan Liu, Naman Goyal, Marjan Ghazvininejad, Abdelrahman Mohamed, Omer Levy, Ves Stoyanov et Luke Zettlemoyer.

- BARThez (de l'École polytechnique) publié dans l'article BARThez: a Skilled Pretrained French Sequence-to-Sequence Model de Moussa Kamal Eddine, Antoine J.-P. Tixier, Michalis Vazirgiannis.

- BARTpho (de VinAI Research) publié dans l'article BARTpho: Pre-trained Sequence-to-Sequence Models for Vietnamese de Nguyen Luong Tran, Duong Minh Le et Dat Quoc Nguyen.

- BEiT (de Microsoft) publié dans l'article BEiT: Pré-entraînement BERT des transformateurs d'images par Hangbo Bao, Li Dong, Furu Wei.

- BERT (de Google) publié dans l'article BERT : Pré-entraînement de transformateurs bidirectionnels profonds pour la compréhension du langage par Jacob Devlin, Ming-Wei Chang, Kenton Lee et Kristina Toutanova.

- BERT For Sequence Generation (de Google) publié dans l'article Leveraging Pre-trained Checkpoints for Sequence Generation Tasks parSascha Rothe, Shashi Narayan, Aliaksei Severyn.

- BERTweet (de VinAI Research) publié dans l'article BERTweet : un modèle de langage pré-entraîné pour les Tweets en anglais par Dat Quoc Nguyen, Thanh Vu et Anh Tuan Nguyen.

- BigBird-Pegasus (de Google Research) publié dans l'article Big Bird: Transformateurs pour des séquences plus longues par Manzil Zaheer, Guru Guruganesh, Avinava Dubey, Joshua Ainslie, Chris Alberti, Santiago Ontanon, Philip Pham, Anirudh Ravula, Qifan Wang, Li Yang, Amr Ahmed.

- BigBird-RoBERTa (de Google Research) publié dans l'article Big Bird: Transformateurs pour des séquences plus longues par Manzil Zaheer, Guru Guruganesh, Avinava Dubey, Joshua Ainslie, Chris Alberti, Santiago Ontanon, Philip Pham, Anirudh Ravula, Qifan Wang, Li Yang, Amr Ahmed.

- BioGpt (de Microsoft Research AI4Science) publié dans l'article BioGPT : transformateur génératif pré-entraîné pour la génération et l'extraction de texte biomédical par Renqian Luo, Liai Sun, Yingce Xia, Tao Qin, Sheng Zhang, Hoifung Poon et Tie-Yan Liu.

- BiT (de Google AI) publié dans l'article Big Transfer (BiT) : Apprentissage général de la représentation visuelle par Alexander Kolesnikov, Lucas Beyer, Xiaohua Zhai, Joan Puigcerver, Jessica Yung, Sylvain Gelly, Neil Houlsby.

- Blenderbot (de Facebook) publié dans l'article Recipes for building an open-domain chatbot par Stephen Roller, Emily Dinan, Naman Goyal, Da Ju, Mary Williamson, Yinhan Liu, Jing Xu, Myle Ott, Kurt Shuster, Eric M. Smith, Y-Lan Boureau, Jason Weston.

- BlenderbotSmall (de Facebook) publié dans l'article Recipes for building an open-domain chatbot par Stephen Roller, Emily Dinan, Naman Goyal, Da Ju, Mary Williamson, Yinhan Liu, Jing Xu, Myle Ott, Kurt Shuster, Eric M. Smith, Y-Lan Boureau, Jason Weston.

- BLIP (de Salesforce) publié dans l'article BLIP : Pré-entraînement de la langue et de l'image par bootstrap pour une compréhension et une génération unifiées de la vision et du langage par Junnan Li, Dongxu Li, Caiming Xiong, Steven Hoi.

- BLIP-2 (de Salesforce) publié dans l'article BLIP-2 : Pré-entraînement de la langue et de l'image avec des encodeurs d'images gelés et de grands modèles de langage par Junnan Li, Dongxu Li, Silvio Savarese, Steven Hoi.

- BLOOM (de l'atelier BigScience) publié par l'atelier BigScience.

- BORT (d'Alexa) publié dans l'article Optimal Subarchitecture Extraction For BERT par Adrian de Wynter et Daniel J. Perry.

- BridgeTower (de l'Institut de technologie de Harbin/Microsoft Research Asia/Intel Labs) publié dans l'article BridgeTower : Construire des ponts entre les encodeurs dans l'apprentissage de la représentation vision-langage par Xiao Xu, Chenfei Wu, Shachar Rosenman, Vasudev Lal, Wanxiang Che, Nan Duan.

- BROS (de NAVER CLOVA) publié dans l'article BROS : un modèle de langage pré-entraîné axé sur le texte et la mise en page pour une meilleure extraction des informations clés des documents par Teakgyu Hong, Donghyun Kim, Mingi Ji, Wonseok Hwang, Daehyun Nam, Sungrae Park.

- ByT5 (de Google Research) publié dans l'article ByT5 : Vers un futur sans jeton avec des modèles pré-entraînés byte-to-byte par Linting Xue, Aditya Barua, Noah Constant, Rami Al-Rfou, Sharan Narang, Mihir Kale, Adam Roberts, Colin Raffel.

- CamemBERT (d'Inria/Facebook/Sorbonne) publié dans l'article CamemBERT : un modèle de langue français savoureux par Louis Martin*, Benjamin Muller*, Pedro Javier Ortiz Suárez*, Yoann Dupont, Laurent Romary, Éric Villemonte de la Clergerie, Djamé Seddah et Benoît Sagot.

- CANINE (de Google Research) publié dans l'article CANINE : Pré-entraînement d'un encodeur sans tokenisation efficace pour la représentation du langage par Jonathan H. Clark, Dan Garrette, Iulia Turc, John Wieting.

- Chinese-CLIP (d'OFA-Sys) publié dans l'article Chinese CLIP : Pré-entraînement contrastif vision-langage en chinois par An Yang, Junshu Pan, Junyang Lin, Rui Men, Yichang Zhang, Jingren Zhou, Chang Zhou.

- CLAP (de LAION-AI) publié dans l'article Large-scale Contrastive Language-Audio Pretraining with Feature Fusion and Keyword-to-Caption Augmentation par Yusong Wu, Ke Chen, Tianyu Zhang, Yuchen Hui, Taylor Berg-Kirkpatrick, Shlomo Dubnov.

- CLIP (d'OpenAI) publié dans l'article Learning Transferable Visual Models From Natural Language Supervision par Alec Radford, Jong Wook Kim, Chris Hallacy, Aditya Ramesh, Gabriel Goh, Sandhini Agarwal, Girish Sastry, Amanda Askell, Pamela Mishkin, Jack Clark, Gretchen Krueger, Ilya Sutskever.

- CLIPSeg (de l'Université de Göttingen) publié dans l'article Image Segmentation Using Text and Image Prompts par Timo Lüddecke et Alexander Ecker.

- CLVP publié dans l'article Better speech synthesis through scaling par James Betker.

- CodeGen (de Salesforce) publié dans l'article A Conversational Paradigm for Program Synthesis par Erik Nijkamp, Bo Pang, Hiroaki Hayashi, Lifu Tu, Huan Wang, Yingbo Zhou, Silvio Savarese, Caiming Xiong.

- CodeLlama (de MetaAI) publié dans l'article Code Llama : Modèles ouverts fondamentaux pour le code par Baptiste Rozière, Jonas Gehring, Fabian Gloeckle, Sten Sootla, Itai Gat, Xiaoqing Ellen Tan, Yossi Adi, Jingyu Liu, Tal Remez, Jérémy Rapin, Artyom Kozhevnikov, Ivan Evtimov, Joanna Bitton, Manish Bhatt, Cristian Canton Ferrer, Aaron Grattafiori, Wenhan Xiong, Alexandre Défossez, Jade Copet, Faisal Azhar, Hugo Touvron, Louis Martin, Nicolas Usunier, Thomas Scialom, Gabriel Synnaeve.

- Cohere (de Cohere) publié dans l'article Command-R: Retrieval Augmented Generation at Production Scale parCohere.

- Conditional DETR (de Microsoft Research Asia) publié dans l'article Conditional DETR for Fast Training Convergence par Depu Meng, Xiaokang Chen, Zejia Fan, Gang Zeng, Houqiang Li, Yuhui Yuan, Lei Sun, Jingdong Wang.

- ConvBERT (de YituTech) publié dans l'article ConvBERT : Amélioration de BERT avec une convolution dynamique basée sur des plages par Zihang Jiang, Weihao Yu, Daquan Zhou, Yunpeng Chen, Jiashi Feng, Shuicheng Yan.

- ConvNeXT (de Facebook AI) publié dans l'article A ConvNet for the 2020s par Zhuang Liu, Hanzi Mao, Chao-Yuan Wu, Christoph Feichtenhofer, Trevor Darrell, Saining Xie.

- ConvNeXTV2 (de Facebook AI) publié dans l'article ConvNeXt V2 : Conception conjointe et mise à l'échelle de ConvNets avec des autoencodeurs masqués par Sanghyun Woo, Shoubhik Debnath, Ronghang Hu, Xinlei Chen, Zhuang Liu, In So Kweon, Saining Xie.

- CPM (de l'Université de Tsinghua) publié dans l'article CPM : Un modèle de langue chinois pré-entraîné génératif à grande échelle par Zhengyan Zhang, Xu Han, Hao Zhou, Pei Ke, Yuxian Gu, Deming Ye, Yujia Qin, Yusheng Su, Haozhe Ji, Jian Guan, Fanchao Qi, Xiaozhi Wang, Yanan Zheng, Guoyang Zeng, Huanqi Cao, Shengqi Chen, Daixuan Li, Zhenbo Sun, Zhiyuan Liu, Minlie Huang, Wentao Han, Jie Tang, Juanzi Li, Xiaoyan Zhu, Maosong Sun.

- CPM-Ant (d'OpenBMB) publié par l'OpenBMB.

- CTRL (de Salesforce) publié dans l'article CTRL : Un modèle de langage conditionnel de type Transformer pour une génération contrôlable par Nitish Shirish Keskar*, Bryan McCann*, Lav R. Varshney, Caiming Xiong et Richard Socher.

- CvT (de Microsoft) publié dans l'article CvT : Introduction de convolutions aux transformateurs visuels par Haiping Wu, Bin Xiao, Noel Codella, Mengchen Liu, Xiyang Dai, Lu Yuan, Lei Zhang.

- Data2Vec (de Facebook) publié dans l'article Data2Vec : Un cadre général pour l'apprentissage auto-supervisé en parole, vision et langage par Alexei Baevski, Wei-Ning Hsu, Qiantong Xu, Arun Babu, Jiatao Gu, Michael Auli.

- DeBERTa (de Microsoft) publié dans l'article DeBERTa : BERT amélioré avec attention désentrelacée par Pengcheng He, Xiaodong Liu, Jianfeng Gao, Weizhu Chen.

- DeBERTa-v2 (de Microsoft) publié dans l'article DeBERTa : BERT amélioré avec attention désentrelacée par Pengcheng He, Xiaodong Liu, Jianfeng Gao, Weizhu Chen.

- Decision Transformer (de Berkeley/Facebook/Google) publié dans l'article Decision Transformer : Apprentissage par renforcement via la modélisation de séquences par Lili Chen, Kevin Lu, Aravind Rajeswaran, Kimin Lee, Aditya Grover, Michael Laskin, Pieter Abbeel, Aravind Srinivas, Igor Mordatch.

- Deformable DETR (de SenseTime Research) publié dans l'article Deformable DETR : Transformateurs déformables pour la détection d'objets de bout en bout par Xizhou Zhu, Weijie Su, Lewei Lu, Bin Li, Xiaogang Wang, Jifeng Dai.

- DeiT (de Facebook) publié dans l'article Entraînement d'images efficace et distillation par l'attention par Hugo Touvron, Matthieu Cord, Matthijs Douze, Francisco Massa, Alexandre Sablayrolles, Hervé Jégou.

- DePlot (de Google AI) publié dans l'article DePlot : Raisonnement visuel en une étape par traduction de l'intrigue en tableau par Fangyu Liu, Julian Martin Eisenschlos, Francesco Piccinno, Syrine Krichene, Chenxi Pang, Kenton Lee, Mandar Joshi, Wenhu Chen, Nigel Collier, Yasemin Altun.

- Depth Anything (de l'université d'Hong Kong et TikTok) publié dans l'article Depth Anything: Unleashing the Power of Large-Scale Unlabeled Data by Lihe Yang, Bingyi Kang, Zilong Huang, Xiaogang Xu, Jiashi Feng, Hengshuang Zhao.

- DETA (de l'Université du Texas à Austin) publié dans l'article NMS Strikes Back par Jeffrey Ouyang-Zhang, Jang Hyun Cho, Xingyi Zhou, Philipp Krähenbühl.

- DETR (de Facebook) publié dans l'article Détection d'objets de bout en bout avec des transformateurs par Nicolas Carion, Francisco Massa, Gabriel Synnaeve, Nicolas Usunier, Alexander Kirillov, Sergey Zagoruyko.

- DialoGPT (de Microsoft Research) publié dans l'article DialoGPT : Pré-entraînement génératif à grande échelle pour la génération de réponses conversationnelles par Yizhe Zhang, Siqi Sun, Michel Galley, Yen-Chun Chen, Chris Brockett, Xiang Gao, Jianfeng Gao, Jingjing Liu, Bill Dolan.

- DiNAT (de SHI Labs) publié dans l'article Transformateur d'attention dilatée pour l'attention aux quartiers par Ali Hassani et Humphrey Shi.

- DINOv2 (de Meta AI) publié dans l'article DINOv2 : Apprentissage de fonctionnalités visuelles robustes sans supervision par Maxime Oquab, Timothée Darcet, Théo Moutakanni, Huy Vo, Marc Szafraniec, Vasil Khalidov, Pierre Fernandez, Daniel Haziza, Francisco Massa, Alaaeldin El-Nouby, Mahmoud Assran, Nicolas Ballas, Wojciech Galuba, Russell Howes, Po-Yao Huang, Shang-Wen Li, Ishan Misra, Michael Rabbat, Vasu Sharma, Gabriel Synnaeve, Hu Xu, Hervé Jegou, Julien Mairal, Patrick Labatut, Armand Joulin, Piotr Bojanowski.

- DistilBERT (de HuggingFace), publié dans l'article DistilBERT, une version condensée de BERT : plus petit, plus rapide, moins cher et plus léger par Victor Sanh, Lysandre Debut et Thomas Wolf. La même méthode a été appliquée pour compresser GPT2 en DistilGPT2, RoBERTa en DistilRoBERTa, Multilingual BERT en DistilmBERT et une version allemande de DistilBERT.

- DiT (de Microsoft Research) publié dans l'article DiT : Auto-pré-entraînement pour le transformateur d'images de documents par Junlong Li, Yiheng Xu, Tengchao Lv, Lei Cui, Cha Zhang, Furu Wei.

- Donut (de NAVER), publié dans l'article Transformation de compréhension de documents sans OCR par Geewook Kim, Teakgyu Hong, Moonbin Yim, Jeongyeon Nam, Jinyoung Park, Jinyeong Yim, Wonseok Hwang, Sangdoo Yun, Dongyoon Han, Seunghyun Park.

- DPR (de Facebook) publié dans l'article Passage dense pour la recherche de réponses à des questions en domaine ouvert par Vladimir Karpukhin, Barlas Oğuz, Sewon Min, Patrick Lewis, Ledell Wu, Sergey Edunov, Danqi Chen et Wen-tau Yih.

- DPT (d'Intel Labs) publié dans l'article Transformateurs de vision pour la prédiction dense par René Ranftl, Alexey Bochkovskiy, Vladlen Koltun.

- EfficientFormer (de Snap Research) publié dans l'article EfficientFormer : Transformateurs de vision à la vitesse de MobileNet par Yanyu Li, Geng Yuan, Yang Wen, Ju Hu, Georgios Evangelidis, Sergey Tulyakov, Yanzhi Wang, Jian Ren.

- EfficientNet (de Google Brain) publié dans l'article EfficientNet: Repenser l'échelle des modèles pour les réseaux de neurones convolutionnels par Mingxing Tan, Quoc V. Le.

- ELECTRA (de Google Research/Université Stanford) publié dans l'article ELECTRA: Pré-entraîner les encodeurs de texte en tant que discriminateurs plutôt que des générateurs par Kevin Clark, Minh-Thang Luong, Quoc V. Le, Christopher D. Manning.

- EnCodec (de Meta AI) publié dans l'article Compression neuronale audio de haute fidélité par Alexandre Défossez, Jade Copet, Gabriel Synnaeve, Yossi Adi.

- EncoderDecoder (de Google Research) publié dans l'article Exploiter des points de contrôle pré-entraînés pour les tâches de génération de séquences par Sascha Rothe, Shashi Narayan, Aliaksei Severyn.

- ERNIE (de Baidu) publié dans l'article ERNIE: Intégration améliorée des représentations par la connaissance par Yu Sun, Shuohuan Wang, Yukun Li, Shikun Feng, Xuyi Chen, Han Zhang, Xin Tian, Danxiang Zhu, Hao Tian, Hua Wu.

- ErnieM (de Baidu) publié dans l'article ERNIE-M: Représentation multilingue améliorée en alignant les sémantiques interlingues avec des corpus monolingues par Xuan Ouyang, Shuohuan Wang, Chao Pang, Yu Sun, Hao Tian, Hua Wu, Haifeng Wang.

- ESM (de Meta AI) sont des modèles de langage de protéines de type transformateur. ESM-1b a été publié dans l'article La structure et la fonction biologiques émergent de la mise à l'échelle de l'apprentissage non supervisé à 250 millions de séquences de protéines par Alexander Rives, Joshua Meier, Tom Sercu, Siddharth Goyal, Zeming Lin, Jason Liu, Demi Guo, Myle Ott, C. Lawrence Zitnick, Jerry Ma et Rob Fergus. ESM-1v a été publié dans l'article Les modèles de langage permettent une prédiction hors champ des effets des mutations sur la fonction des protéines par Joshua Meier, Roshan Rao, Robert Verkuil, Jason Liu, Tom Sercu et Alexander Rives. ESM-2 et ESMFold ont été publiés avec l'article Les modèles de langage des séquences de protéines à l'échelle de l'évolution permettent une prédiction précise de la structure par Zeming Lin, Halil Akin, Roshan Rao, Brian Hie, Zhongkai Zhu, Wenting Lu, Allan dos Santos Costa, Maryam Fazel-Zarandi, Tom Sercu, Sal Candido, Alexander Rives.

- Falcon (de Technology Innovation Institute) par Almazrouei, Ebtesam et Alobeidli, Hamza et Alshamsi, Abdulaziz et Cappelli, Alessandro et Cojocaru, Ruxandra et Debbah, Merouane et Goffinet, Etienne et Heslow, Daniel et Launay, Julien et Malartic, Quentin et Noune, Badreddine et Pannier, Baptiste et Penedo, Guilherme.

- FastSpeech2Conformer (d'ESPnet) publié dans l'article Développements récents sur la boîte à outils Espnet boostés par Conformer par Pengcheng Guo, Florian Boyer, Xuankai Chang, Tomoki Hayashi, Yosuke Higuchi, Hirofumi Inaguma, Naoyuki Kamo, Chenda Li, Daniel Garcia-Romero, Jiatong Shi, Jing Shi, Shinji Watanabe, Kun Wei, Wangyou Zhang et Yuekai Zhang.

- FLAN-T5 (de Google AI) publié dans le référentiel google-research/t5x par Hyung Won Chung, Le Hou, Shayne Longpre, Barret Zoph, Yi Tay, William Fedus, Eric Li, Xuezhi Wang, Mostafa Dehghani, Siddhartha Brahma, Albert Webson, Shixiang Shane Gu, Zhuyun Dai, Mirac Suzgun, Xinyun Chen, Aakanksha Chowdhery, Sharan Narang, Gaurav Mishra, Adams Yu, Vincent Zhao, Yanping Huang, Andrew Dai, Hongkun Yu, Slav Petrov, Ed H. Chi, Jeff Dean, Jacob Devlin, Adam Roberts, Denny Zhou, Quoc V. Le et Jason Wei

- FLAN-UL2 (de Google AI) publié dans le référentiel google-research/t5x par Hyung Won Chung, Le Hou, Shayne Longpre, Barret Zoph, Yi Tay, William Fedus, Eric Li, Xuezhi Wang, Mostafa Dehghani, Siddhartha Brahma, Albert Webson, Shixiang Shane Gu, Zhuyun Dai, Mirac Suzgun, Xinyun Chen, Aakanksha Chowdhery, Sharan Narang, Gaurav Mishra, Adams Yu, Vincent Zhao, Yanping Huang, Andrew Dai, Hongkun Yu, Slav Petrov, Ed H. Chi, Jeff Dean, Jacob Devlin, Adam Roberts, Denny Zhou, Quoc V. Le et Jason Wei

- FlauBERT (du CNRS) publié dans l'article FlauBERT : Pré-entraînement de modèle de langue non supervisé pour le français par Hang Le, Loïc Vial, Jibril Frej, Vincent Segonne, Maximin Coavoux, Benjamin Lecouteux, Alexandre Allauzen, Benoît Crabbé, Laurent Besacier, Didier Schwab.

- FLAVA (de Facebook AI) publié dans l'article FLAVA : Un modèle fondamental d'alignement de la langue et de la vision par Amanpreet Singh, Ronghang Hu, Vedanuj Goswami, Guillaume Couairon, Wojciech Galuba, Marcus Rohrbach et Douwe Kiela.

- FNet (de Google Research) publié dans l'article FNet : Mélanger les jetons avec des transformations de Fourier par James Lee-Thorp, Joshua Ainslie, Ilya Eckstein, Santiago Ontanon.

- FocalNet (de Microsoft Research) publié dans l'article Réseaux de modulation focale par Jianwei Yang, Chunyuan Li, Xiyang Dai, Lu Yuan, Jianfeng Gao.

- Funnel Transformer (de l'Université Carnegie Mellon/Google Brain) publié dans l'article Funnel-Transformer : Filtrer la redondance séquentielle pour un traitement efficace du langage par Zihang Dai, Guokun Lai, Yiming Yang, Quoc V. Le.

- Fuyu (de ADEPT) Rohan Bavishi, Erich Elsen, Curtis Hawthorne, Maxwell Nye, Augustus Odena, Arushi Somani, Sağnak Taşırlar. Publié dans l'article billet de blog

- Gemma (de Google) publié dans l'article Gemma: Open Models Based on Gemini Technology and Research parthe Gemma Google team.

- GIT (de Microsoft Research) publié dans l'article GIT : Un transformateur génératif d'images en texte pour la vision et le langage par Jianfeng Wang, Zhengyuan Yang, Xiaowei Hu, Linjie Li, Kevin Lin, Zhe Gan, Zicheng Liu, Ce Liu, Lijuan Wang.

- GLPN (de la KAIST) publié dans l'article Réseaux de chemins globaux-locaux pour l'estimation de profondeur monoculaire avec Vertical CutDepth par Doyeon Kim, Woonghyun Ga, Pyungwhan Ahn, Donggyu Joo, Sehwan Chun, Junmo Kim.

- GPT (d'OpenAI) publié dans l'article Améliorer la compréhension du langage par l'apprentissage préalable génératif par Alec Radford, Karthik Narasimhan, Tim Salimans et Ilya Sutskever.

- GPT Neo (d'EleutherAI) publié dans le référentiel EleutherAI/gpt-neo par Sid Black, Stella Biderman, Leo Gao, Phil Wang et Connor Leahy.

- GPT NeoX (d'EleutherAI) publié dans l'article GPT-NeoX-20B: Un modèle de langue autonome open source par Sid Black, Stella Biderman, Eric Hallahan, Quentin Anthony, Leo Gao, Laurence Golding, Horace He, Connor Leahy, Kyle McDonell, Jason Phang, Michael Pieler, USVSN Sai Prashanth, Shivanshu Purohit, Laria Reynolds, Jonathan Tow, Ben Wang, Samuel Weinbach

- GPT NeoX Japanese (de ABEJA) publié par Shinya Otani, Takayoshi Makabe, Anuj Arora et Kyo Hattori.

- GPT-2 (d'OpenAI) a été publié dans l'article Les modèles de langage sont des apprenants multitâches non supervisés par Alec Radford, Jeffrey Wu, Rewon Child, David Luan, Dario Amodei et Ilya Sutskever.

- GPT-J (d'EleutherAI) a été publié dans le dépôt kingoflolz/mesh-transformer-jax par Ben Wang et Aran Komatsuzaki.

- GPT-Sw3 (d'AI-Sweden) a été publié dans l'article Leçons apprises de GPT-SW3 : Construction du premier modèle de langage génératif à grande échelle pour le suédois par Ariel Ekgren, Amaru Cuba Gyllensten, Evangelia Gogoulou, Alice Heiman, Severine Verlinden, Joey Öhman, Fredrik Carlsson, Magnus Sahlgren.

- GPTBigCode (de BigCode) a été publié dans l'article SantaCoder: ne visez pas les étoiles ! par Loubna Ben Allal, Raymond Li, Denis Kocetkov, Chenghao Mou, Christopher Akiki, Carlos Munoz Ferrandis, Niklas Muennighoff, Mayank Mishra, Alex Gu, Manan Dey, Logesh Kumar Umapathi, Carolyn Jane Anderson, Yangtian Zi, Joel Lamy Poirier, Hailey Schoelkopf, Sergey Troshin, Dmitry Abulkhanov, Manuel Romero, Michael Lappert, Francesco De Toni, Bernardo García del Río, Qian Liu, Shamik Bose, Urvashi Bhattacharyya, Terry Yue Zhuo, Ian Yu, Paulo Villegas, Marco Zocca, Sourab Mangrulkar, David Lansky, Huu Nguyen, Danish Contractor, Luis Villa, Jia Li, Dzmitry Bahdanau, Yacine Jernite, Sean Hughes, Daniel Fried, Arjun Guha, Harm de Vries, Leandro von Werra.

- GPTSAN-japanese a été publié dans le dépôt tanreinama/GPTSAN par Toshiyuki Sakamoto (tanreinama).

- Graphormer (de Microsoft) a été publié dans l'article Les Transformers sont-ils vraiment inefficaces pour la représentation graphique ? par Chengxuan Ying, Tianle Cai, Shengjie Luo, Shuxin Zheng, Guolin Ke, Di He, Yanming Shen, Tie-Yan Liu.

- GroupViT (de l'UCSD, NVIDIA) a été publié dans l'article GroupViT : la segmentation sémantique émerge de la supervision textuelle par Jiarui Xu, Shalini De Mello, Sifei Liu, Wonmin Byeon, Thomas Breuel, Jan Kautz, Xiaolong Wang.

- HerBERT (d'Allegro.pl, AGH University of Science and Technology) a été publié dans l'article KLEJ : référentiel complet pour la compréhension du langage polonais par Piotr Rybak, Robert Mroczkowski, Janusz Tracz, Ireneusz Gawlik.

- Hubert (de Facebook) a été publié dans l'article HuBERT : Apprentissage de la représentation autonome de la parole par prédiction masquée des unités cachées par Wei-Ning Hsu, Benjamin Bolte, Yao-Hung Hubert Tsai, Kushal Lakhotia, Ruslan Salakhutdinov, Abdelrahman Mohamed.

- I-BERT (de Berkeley) a été publié dans l'article I-BERT : Quantification entière de BERT avec des entiers uniquement par Sehoon Kim, Amir Gholami, Zhewei Yao, Michael W. Mahoney, Kurt Keutzer.

- IDEFICS (de HuggingFace) a été publié dans l'article OBELICS : Un ensemble de données filtré à l'échelle du Web d'intercalation de documents texte-image par Hugo Laurençon, Lucile Saulnier, Léo Tronchon, Stas Bekman, Amanpreet Singh, Anton Lozhkov, Thomas Wang, Siddharth Karamcheti, Alexander M. Rush, Douwe Kiela, Matthieu Cord, Victor Sanh.

- ImageGPT (d'OpenAI) a été publié dans l'article Pré-entraînement génératif à partir de pixels par Mark Chen, Alec Radford, Rewon Child, Jeffrey Wu, Heewoo Jun, David Luan, Ilya Sutskever.

- Informer (de l'Université de Beihang, UC Berkeley, Rutgers University, SEDD Company) a été publié dans l'article [Informer : Au-delà du Transformer efficace pour la prévision de séries temporel

- InstructBLIP (de Salesforce) a été publié dans l'article InstructBLIP : Vers des modèles vision-langage polyvalents avec un réglage d'instructions de Wenliang Dai, Junnan Li, Dongxu Li, Anthony Meng Huat Tiong, Junqi Zhao, Weisheng Wang, Boyang Li, Pascale Fung, Steven Hoi.

- Jukebox (d'OpenAI) a été publié dans l'article Jukebox : Un modèle génératif pour la musique de Prafulla Dhariwal, Heewoo Jun, Christine Payne, Jong Wook Kim, Alec Radford, Ilya Sutskever.

- KOSMOS-2 (de Microsoft Research Asia) a été publié dans l'article Kosmos-2 : Ancrage de modèles linguistiques multimodaux à travers le monde de Zhiliang Peng, Wenhui Wang, Li Dong, Yaru Hao, Shaohan Huang, Shuming Ma, Furu Wei.

- LayoutLM (de Microsoft Research Asia) a été publié dans l'article LayoutLM : Pré-entraînement de texte et de mise en page pour la compréhension d'images de documents de Yiheng Xu, Minghao Li, Lei Cui, Shaohan Huang, Furu Wei, Ming Zhou.

- LayoutLMv2 (de Microsoft Research Asia) a été publié dans l'article LayoutLMv2 : Pré-entraînement multimodal pour la compréhension visuellement riche de documents de Yang Xu, Yiheng Xu, Tengchao Lv, Lei Cui, Furu Wei, Guoxin Wang, Yijuan Lu, Dinei Florencio, Cha Zhang, Wanxiang Che, Min Zhang, Lidong Zhou.

- LayoutLMv3 (de Microsoft Research Asia) a été publié dans l'article LayoutLMv3 : Pré-entraînement pour l'IA de documents avec un masquage de texte et d'image unifié de Yupan Huang, Tengchao Lv, Lei Cui, Yutong Lu, Furu Wei.

- LayoutXLM (de Microsoft Research Asia) a été publié dans l'article LayoutXLM : Pré-entraînement multimodal pour la compréhension de documents visuellement riches et multilingues de Yiheng Xu, Tengchao Lv, Lei Cui, Guoxin Wang, Yijuan Lu, Dinei Florencio, Cha Zhang, Furu Wei.

- LED (d'AllenAI) a été publié dans l'article Longformer : Le transformateur de documents longs de Iz Beltagy, Matthew E. Peters, Arman Cohan.

- LeViT (de Meta AI) a été publié dans l'article LeViT : Un transformateur de vision déguisé en réseau de neurones convolutionnel pour une inférence plus rapide de Ben Graham, Alaaeldin El-Nouby, Hugo Touvron, Pierre Stock, Armand Joulin, Hervé Jégou, Matthijs Douze.

- LiLT (de l'Université de technologie du Sud de la Chine) a été publié dans l'article LiLT : Un transformateur de mise en page simple mais efficace et indépendant de la langue pour la compréhension de documents structurés de Jiapeng Wang, Lianwen Jin, Kai Ding.

- LLaMA (de l'équipe FAIR de Meta AI) a été publié dans l'article LLaMA : Modèles linguistiques de base ouverts et efficaces de Hugo Touvron, Thibaut Lavril, Gautier Izacard, Xavier Martinet, Marie-Anne Lachaux, Timothée Lacroix, Baptiste Rozière, Naman Goyal, Eric Hambro, Faisal Azhar, Aurelien Rodriguez, Armand Joulin, Edouard Grave, Guillaume Lample.

- Llama2 (de l'équipe FAIR de Meta AI) a été publié dans l'article Llama2 : Modèles de base ouverts et affinés pour le chat de Hugo Touvron, Louis Martin, Kevin Stone, Peter Albert, Amjad Almahairi, Yasmine Babaei, Nikolay Bashlykov, Soumya Batra, Prajjwal Bhargava, Shruti Bhosale, Dan Bikel, Lukas Blecher, Cristian Canton Ferrer, Moya Chen, Guillem Cucurull, David Esiobu, Jude Fernandes, Jeremy Fu, Wenyin Fu, Brian Fuller, Cynthia Gao, Vedanuj Goswami, Naman Goyal, Anthony Hartshorn, Saghar Hosseini, Rui Hou, Hakan Inan, Marcin Kardas, Viktor Kerkez Madian Khabsa, Isabel Kloumann, Artem Korenev, Punit Singh Koura, Marie-Anne Lachaux, Thibaut Lavril, Jenya Lee, Diana Liskovich, Yinghai Lu, Yuning Mao, Xavier Martinet, Todor Mihaylov, Pushka rMishra, Igor Molybog, Yixin Nie, Andrew Poulton, Jeremy Reizenstein, Rashi Rungta, Kalyan Saladi, Alan Schelten, Ruan Silva, Eric Michael Smith, Ranjan Subramanian, Xiaoqing EllenTan, Binh Tang, Ross Taylor, Adina Williams, Jian Xiang Kuan, Puxin Xu, Zheng Yan, Iliyan Zarov, Yuchen Zhang, Angela Fan, Melanie Kambadur, Sharan Narang, Aurelien Rodriguez, Robert Stojnic, Sergey Edunov, Thomas Scialom.

- LLaVa (de Microsoft Research & University of Wisconsin-Madison) a été publié dans l'article Visual Instruction Tuning de Haotian Liu, Chunyuan Li, Yuheng Li et Yong Jae Lee.

- Longformer (d'AllenAI) a été publié dans l'article Longformer : Le transformateur de documents longs de Iz Beltagy, Matthew E. Peters, Arman Cohan.

- LongT5 (de Google AI) a été publié dans l'article LongT5 : Transformateur de texte-à-texte efficace pour de longues séquences de Mandy Guo, Joshua Ainslie, David Uthus, Santiago Ontanon, Jianmo Ni, Yun-Hsuan Sung, Yinfei Yang.

- LUKE (de Studio Ousia) a été publié dans l'article LUKE : Représentations contextuelles profondes d'entités avec auto-attention consciente des entités de Ikuya Yamada, Akari Asai, Hiroyuki Shindo, Hideaki Takeda, Yuji Matsumoto.

- LXMERT (de l'UNC Chapel Hill) a été publié dans l'article LXMERT : Apprentissage de représentations d'encodeur cross-modal à partir de transformateurs pour le questionnement en domaine ouvert de Hao Tan et Mohit Bansal.

- M-CTC-T (de Facebook) a été publié dans l'article Pseudo-Labeling For Massively Multilingual Speech Recognition de Loren Lugosch, Tatiana Likhomanenko, Gabriel Synnaeve et Ronan Collobert.

- M2M100 (de Facebook) a été publié dans l'article Beyond English-Centric Multilingual Machine Translation de Angela Fan, Shruti Bhosale, Holger Schwenk, Zhiyi Ma, Ahmed El-Kishky, Siddharth Goyal, Mandeep Baines, Onur Celebi, Guillaume Wenzek, Vishrav Chaudhary, Naman Goyal, Tom Birch, Vitaliy Liptchinsky, Sergey Edunov, Edouard Grave, Michael Auli, Armand Joulin.

- MADLAD-400 (de Google) a été publié dans l'article MADLAD-400 : Un ensemble de données multilingue et de niveau document de Sneha Kudugunta, Isaac Caswell, Biao Zhang, Xavier Garcia, Christopher A. Choquette-Choo, Katherine Lee, Derrick Xin, Aditya Kusupati, Romi Stella, Ankur Bapna, Orhan Firat.

- Mamba (de Albert Gu and Tri Dao) publié dans l'article Mamba: Linear-Time Sequence Modeling with Selective State Spaces parAlbert Gu and Tri Dao.

- MarianMT Des modèles de traduction automatique formés avec les données OPUS par Jörg Tiedemann. Le cadre Marian est en cours de développement par l'équipe Microsoft Translator.

- MarkupLM (de Microsoft Research Asia) a été publié dans l'article MarkupLM : Pré-entraînement de texte et de langage de balisage pour la compréhension visuellement riche de documents de Junlong Li, Yiheng Xu, Lei Cui, Furu Wei.

- Mask2Former (de FAIR et UIUC) a été publié dans l'article Masked-attention Mask Transformer for Universal Image Segmentation de Bowen Cheng, Ishan Misra, Alexander G. Schwing, Alexander Kirillov, Rohit Girdhar.

- MaskFormer (de Meta et UIUC) a été publié dans l'article Per-Pixel Classification is Not All You Need for Semantic Segmentation de Bowen Cheng, Alexander G. Schwing, Alexander Kirillov.

- MatCha (de Google AI) a été publié dans l'article MatCha : Amélioration du pré-entraînement de langage visuel avec raisonnement mathématique et décomposition de graphiques de Fangyu Liu, Francesco Piccinno, Syrine Krichene, Chenxi Pang, Kenton Lee, Mandar Joshi, Yasemin Altun, Nigel Collier, Julian Martin Eisenschlos.

- mBART (de Facebook) a été publié dans l'article [Pré-entraînement de débruitage multilingue pour la traduction automatique neuronale

- mBART-50 (de Facebook) a été publié dans l'article Traduction multilingue avec un pré-entraînement et un fine-tuning multilingues extensibles par Yuqing Tang, Chau Tran, Xian Li, Peng-Jen Chen, Naman Goyal, Vishrav Chaudhary, Jiatao Gu, Angela Fan.

- MEGA (de Meta/USC/CMU/SJTU) a été publié dans l'article Mega : Attention équipée d'une moyenne mobile par Xuezhe Ma, Chunting Zhou, Xiang Kong, Junxian He, Liangke Gui, Graham Neubig, Jonathan May et Luke Zettlemoyer.

- Megatron-BERT (de NVIDIA) a été publié dans l'article Megatron-LM : Entraînement de modèles linguistiques de plusieurs milliards de paramètres en utilisant le parallélisme de modèle par Mohammad Shoeybi, Mostofa Patwary, Raul Puri, Patrick LeGresley, Jared Casper et Bryan Catanzaro.

- Megatron-GPT2 (de NVIDIA) a été publié dans l'article Megatron-LM : Entraînement de modèles linguistiques de plusieurs milliards de paramètres en utilisant le parallélisme de modèle par Mohammad Shoeybi, Mostofa Patwary, Raul Puri, Patrick LeGresley, Jared Casper et Bryan Catanzaro.

- MGP-STR (d'Alibaba Research) a été publié dans l'article Prédiction multi-granularité pour la reconnaissance de texte de scène par Peng Wang, Cheng Da et Cong Yao.

- Mistral (de Mistral AI) par l'équipe Mistral AI : Albert Jiang, Alexandre Sablayrolles, Arthur Mensch, Chris Bamford, Devendra Singh Chaplot, Diego de las Casas, Florian Bressand, Gianna Lengyel, Guillaume Lample, Lélio Renard Lavaud, Lucile Saulnier, Marie-Anne Lachaux, Pierre Stock, Teven Le Scao, Thibaut Lavril, Thomas Wang, Timothée Lacroix, William El Sayed.

- Mixtral (de Mistral AI) par l'équipe Mistral AI : Albert Jiang, Alexandre Sablayrolles, Arthur Mensch, Chris Bamford, Devendra Singh Chaplot, Diego de las Casas, Florian Bressand, Gianna Lengyel, Guillaume Lample, Lélio Renard Lavaud, Lucile Saulnier, Marie-Anne Lachaux, Pierre Stock, Teven Le Scao, Thibaut Lavril, Thomas Wang, Timothée Lacroix, William El Sayed.

- mLUKE (de Studio Ousia) a été publié dans l'article mLUKE : La puissance des représentations d'entités dans les modèles linguistiques pré-entraînés multilingues par Ryokan Ri, Ikuya Yamada et Yoshimasa Tsuruoka.

- MMS (de Facebook) a été publié dans l'article Mise à l'échelle de la technologie de la parole à plus de 1 000 langues par Vineel Pratap, Andros Tjandra, Bowen Shi, Paden Tomasello, Arun Babu, Sayani Kundu, Ali Elkahky, Zhaoheng Ni, Apoorv Vyas, Maryam Fazel-Zarandi, Alexei Baevski, Yossi Adi, Xiaohui Zhang, Wei-Ning Hsu, Alexis Conneau, Michael Auli.

- MobileBERT (de CMU/Google Brain) a été publié dans l'article MobileBERT : un BERT compact et agnostique pour les tâches sur les appareils à ressources limitées par Zhiqing Sun, Hongkun Yu, Xiaodan Song, Renjie Liu, Yiming Yang et Denny Zhou.

- MobileNetV1 (de Google Inc.) a été publié dans l'article MobileNets : Réseaux neuronaux convolutifs efficaces pour les applications de vision mobile par Andrew G. Howard, Menglong Zhu, Bo Chen, Dmitry Kalenichenko, Weijun Wang, Tobias Weyand, Marco Andreetto, Hartwig Adam.

- MobileNetV2 (de Google Inc.) a été publié dans l'article MobileNetV2 : Résidus inversés et coudes linéaires par Mark Sandler, Andrew Howard, Menglong Zhu, Andrey Zhmoginov, Liang-Chieh Chen.

- MobileViT (d'Apple) a été publié dans l'article MobileViT : Vision Transformer léger, polyvalent et adapté aux mobiles par Sachin Mehta et Mohammad Rastegari.

- MobileViTV2 (d'Apple) a été publié dans l'article Auto-attention séparable pour les Vision Transformers mobiles par Sachin Mehta et Mohammad Rastegari.

- MPNet (de Microsoft Research) a été publié dans l'article MPNet : Pré-entraînement masqué et permuté pour la compréhension du langage par Kaitao Song, Xu Tan, Tao Qin, Jianfeng Lu, Tie-Yan Liu.

- MPT (de MosaiML) a été publié avec le référentiel llm-foundry par l'équipe MosaiML NLP.

- MRA (de l'Université du Wisconsin - Madison) a été publié dans l'article Analyse multi-résolution (MRA) pour une auto-attention approximative par Zhanpeng Zeng, Sourav Pal, Jeffery Kline, Glenn M Fung, Vikas Singh.

- MT5 (de Google AI) a été publié dans l'article mT5 : un transformateur texte-à-texte pré-entraîné massivement multilingue par Linting Xue, Noah Constant, Adam Roberts, Mihir Kale, Rami Al-Rfou, Aditya Siddhant, Aditya Barua, Colin Raffel.

- MusicGen (de Meta) a été publié dans l'article Génération de musique simple et contrôlable par Jade Copet, Felix Kreuk, Itai Gat, Tal Remez, David Kant, Gabriel Synnaeve, Yossi Adi et Alexandre Défossez.

- MusicGen Melody (de Meta) publié dans l'article Simple and Controllable Music Generation parJade Copet, Felix Kreuk, Itai Gat, Tal Remez, David Kant, Gabriel Synnaeve, Yossi Adi and Alexandre Défossez.

- MVP (de RUC AI Box) a été publié dans l'article MVP : Pré-entraînement supervisé multi-tâche pour la génération de langage naturel par Tianyi Tang, Junyi Li, Wayne Xin Zhao et Ji-Rong Wen.

- NAT (de SHI Labs) a été publié dans l'article Transformateur d'attention de voisinage par Ali Hassani, Steven Walton, Jiachen Li, Shen Li et Humphrey Shi.

- Nezha (du laboratoire Noah's Ark de Huawei) a été publié dans l'article NEZHA : Représentation contextualisée neurale pour la compréhension du langage chinois par Junqiu Wei, Xiaozhe Ren, Xiaoguang Li, Wenyong Huang, Yi Liao, Yasheng Wang, Jiashu Lin, Xin Jiang, Xiao Chen et Qun Liu.

- NLLB (de Meta) a été publié dans l'article No Language Left Behind : Mise à l'échelle de la traduction automatique centrée sur l'humain par l'équipe NLLB.

- NLLB-MOE (de Meta) a été publié dans l'article No Language Left Behind : Mise à l'échelle de la traduction automatique centrée sur l'humain par l'équipe NLLB.

- Nougat (de Meta AI) a été publié dans l'article Nougat : Compréhension Optique Neuronale pour les Documents Académiques par Lukas Blecher, Guillem Cucurull, Thomas Scialom, Robert Stojnic.

- Nyströmformer (de l'Université du Wisconsin - Madison) a été publié dans l'article Nyströmformer : Un algorithme basé sur Nyström pour approximer l'auto-attention par Yunyang Xiong, Zhanpeng Zeng, Rudrasis Chakraborty, Mingxing Tan, Glenn Fung, Yin Li, Vikas Singh.

- OneFormer (de SHI Labs) a été publié dans l'article OneFormer : Un Transformer pour dominer la segmentation universelle d'images par Jitesh Jain, Jiachen Li, MangTik Chiu, Ali Hassani, Nikita Orlov, Humphrey Shi.

- OpenLlama (de s-JoL) publié sur GitHub (maintenant supprimé).

- OPT (de Meta AI) a été publié dans l'article OPT : Modèles linguistiques Transformer pré-entraînés ouverts par Susan Zhang, Stephen Roller, Naman Goyal, Mikel Artetxe, Moya Chen, Shuohui Chen et al.

- OWL-ViT (de Google AI) a été publié dans l'article OWL-ViT : Détection d'objets simple à vocabulaire ouvert avec des transformateurs de vision par Matthias Minderer, Alexey Gritsenko, Austin Stone, Maxim Neumann, Dirk Weissenborn, Alexey Dosovitskiy, Aravindh Mahendran, Anurag Arnab, Mostafa Dehghani, Zhuoran Shen, Xiao Wang, Xiaohua Zhai, Thomas Kipf et Neil Houlsby.

- OWLv2 (de Google AI) a été publié dans l'article Scaling Open-Vocabulary Object Detection par Matthias Minderer, Alexey Gritsenko, Neil Houlsby.

- PatchTSMixer (d'IBM Research) a été publié dans l'article TSMixer : Modèle MLP-Mixer léger pour la prévision multivariée de séries temporelles par Vijay Ekambaram, Arindam Jati, Nam Nguyen, Phanwadee Sinthong, Jayant Kalagnanam.

- PatchTST (d'IBM) a été publié dans l'article Une série temporelle vaut 64 mots : Prévision à long terme avec des Transformers par Yuqi Nie, Nam H. Nguyen, Phanwadee Sinthong, Jayant Kalagnanam.

- Pegasus (de Google) a été publié dans l'article PEGASUS : Pré-entraînement avec Phrases-Écart Extraites pour la Résumé Abstrait par Jingqing Zhang, Yao Zhao, Mohammad Saleh et Peter J. Liu.

- PEGASUS-X (de Google) a été publié dans l'article Investiguer l'Extension Efficace des Transformers pour la Longue Summarization d'Entrée par Jason Phang, Yao Zhao et Peter J. Liu.

- Perceiver IO (de Deepmind) a été publié dans l'article Perceiver IO : Une architecture générale pour les entrées et sorties structurées par Andrew Jaegle, Sebastian Borgeaud, Jean-Baptiste Alayrac, Carl Doersch, Catalin Ionescu, David Ding, Skanda Koppula, Daniel Zoran, Andrew Brock, Evan Shelhamer, Olivier Hénaff, Matthew M. Botvinick, Andrew Zisserman, Oriol Vinyals et João Carreira.

- Persimmon (d'ADEPT) a été publié dans un billet de blog par Erich Elsen, Augustus Odena, Maxwell Nye, Sağnak Taşırlar, Tri Dao, Curtis Hawthorne, Deepak Moparthi, Arushi Somani.

- Phi (de Microsoft) a été publié avec les articles - Textbooks Are All You Need par Suriya Gunasekar, Yi Zhang, Jyoti Aneja, Caio César Teodoro Mendes, Allie Del Giorno, Sivakanth Gopi, Mojan Javaheripi, Piero Kauffmann, Gustavo de Rosa, Olli Saarikivi, Adil Salim, Shital Shah, Harkirat Singh Behl, Xin Wang, Sébastien Bubeck, Ronen Eldan, Adam Tauman Kalai, Yin Tat Lee et Yuanzhi Li, Textbooks Are All You Need II : Rapport technique phi-1.5 par Yuanzhi Li, Sébastien Bubeck, Ronen Eldan, Allie Del Giorno, Suriya Gunasekar et Yin Tat Lee.

- PhoBERT (de VinAI Research) a été publié dans l'article PhoBERT : Modèles linguistiques pré-entraînés pour le vietnamien par Dat Quoc Nguyen et Anh Tuan Nguyen.

- Pix2Struct (de Google) a été publié dans l'article Pix2Struct : Analyse d'images d'écran en tant que pré-entraînement pour la compréhension du langage visuel par Kenton Lee, Mandar Joshi, Iulia Turc, Hexiang Hu, Fangyu Liu, Julian Eisenschlos, Urvashi Khandelwal, Peter Shaw, Ming-Wei Chang, Kristina Toutanova.

- PLBart (de UCLA NLP) a été publié dans l'article Unified Pre-training for Program Understanding and Generation par Wasi Uddin Ahmad, Saikat Chakraborty, Baishakhi Ray, Kai-Wei Chang.

- PoolFormer (de Sea AI Labs) a été publié dans l'article MetaFormer is Actually What You Need for Vision par Yu, Weihao et Luo, Mi et Zhou, Pan et Si, Chenyang et Zhou, Yichen et Wang, Xinchao et Feng, Jiashi et Yan, Shuicheng.

- Pop2Piano a été publié dans l'article Pop2Piano : Génération de reprises de morceaux de piano basée sur l'audio pop par Jongho Choi et Kyogu Lee.

- ProphetNet (de Microsoft Research) a été publié dans l'article ProphetNet : Prédire les N-grammes futurs pour l'entraînement préalable de séquences à séquences par Yu Yan, Weizhen Qi, Yeyun Gong, Dayiheng Liu, Nan Duan, Jiusheng Chen, Ruofei Zhang et Ming Zhou.

- PVT (de l'Université de Nankin, l'Université de Hong Kong, etc.) a été publié dans l'article Pyramid Vision Transformer : Une colonne vertébrale polyvalente pour la prédiction dense sans convolutions par Wenhai Wang, Enze Xie, Xiang Li, Deng-Ping Fan, Kaitao Song, Ding Liang, Tong Lu, Ping Luo et Ling Shao.

- PVTv2 (de Shanghai AI Laboratory, Nanjing University, The University of Hong Kong etc.) publié dans l'article PVT v2: Improved Baselines with Pyramid Vision Transformer parWenhai Wang, Enze Xie, Xiang Li, Deng-Ping Fan, Kaitao Song, Ding Liang, Tong Lu, Ping Luo, Ling Shao.

- QDQBert (de NVIDIA) a été publié dans l'article Quantification entière pour l'inférence d'apprentissage profond : Principes et évaluation empirique par Hao Wu, Patrick Judd, Xiaojie Zhang, Mikhail Isaev et Paulius Micikevicius.

- Qwen2 (de l'équipe Qwen, Alibaba Group) a été publié avec le rapport technique Qwen par Jinze Bai, Shuai Bai, Yunfei Chu, Zeyu Cui, Kai Dang, Xiaodong Deng, Yang Fan, Wenbin Ge, Yu Han, Fei Huang, Binyuan Hui, Luo Ji, Mei Li, Junyang Lin, Runji Lin, Dayiheng Liu, Gao Liu, Chengqiang Lu, Keming Lu, Jianxin Ma, Rui Men, Xingzhang Ren, Xuancheng Ren, Chuanqi Tan, Sinan Tan, Jianhong Tu, Peng Wang, Shijie Wang, Wei Wang, Shengguang Wu, Benfeng Xu, Jin Xu, An Yang, Hao Yang, Jian Yang, Shusheng Yang, Yang Yao, Bowen Yu, Hongyi Yuan, Zheng Yuan, Jianwei Zhang, Xingxuan Zhang, Yichang Zhang, Zhenru Zhang, Chang Zhou, Jingren Zhou, Xiaohuan Zhou et Tianhang Zhu.

- RAG (de Facebook) a été publié dans l'article Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks par Patrick Lewis, Ethan Perez, Aleksandara Piktus, Fabio Petroni, Vladimir Karpukhin, Naman Goyal, Heinrich Küttler, Mike Lewis, Wen-tau Yih, Tim Rocktäschel, Sebastian Riedel, Douwe Kiela.

- REALM (de Google Research) a été publié dans l'article REALM : Pré-entraînement de modèle linguistique augmenté par la récupération par Kelvin Guu, Kenton Lee, Zora Tung, Panupong Pasupat et Ming-Wei Chang.

- Reformer (de Google Research) a été publié dans l'article Reformer : Le transformateur efficace par Nikita Kitaev, Łukasz Kaiser, Anselm Levskaya.

- RegNet (de META Platforms) a été publié dans l'article Designing Network Design Space par Ilija Radosavovic, Raj Prateek Kosaraju, Ross Girshick, Kaiming He, Piotr Dollár.

- RemBERT (de Google Research) a été publié dans l'article Rethinking embedding coupling in pre-trained language models par Hyung Won Chung, Thibault Févry, Henry Tsai, M. Johnson, Sebastian Ruder.

- ResNet (de Microsoft Research) a été publié dans l'article Deep Residual Learning for Image Recognition par Kaiming He, Xiangyu Zhang, Shaoqing Ren, Jian Sun.

- RoBERTa (de Facebook), publié dans l'article RoBERTa : Une approche d'entraînement préalable BERT robuste par Yinhan Liu, Myle Ott, Naman Goyal, Jingfei Du, Mandar Joshi, Danqi Chen, Omer Levy, Mike Lewis, Luke Zettlemoyer, Veselin Stoyanov.

- RoBERTa-PreLayerNorm (de Facebook) a été publié dans l'article fairseq : Une boîte à outils rapide et extensible pour la modélisation de séquences par Myle Ott, Sergey Edunov, Alexei Baevski, Angela Fan, Sam Gross, Nathan Ng, David Grangier, Michael Auli.

- RoCBert (de WeChatAI) a été publié dans l'article RoCBert : BERT chinois robuste avec pré-entraînement contrastif multimodal par HuiSu, WeiweiShi, XiaoyuShen, XiaoZhou, TuoJi, JiaruiFang, JieZhou.

- RoFormer (de ZhuiyiTechnology), publié dans l'article RoFormer : Transformateur amélioré avec insertion rotative de position par Jianlin Su et Yu Lu et Shengfeng Pan et Bo Wen et Yunfeng Liu.

- RWKV (de Bo Peng), publié sur ce référentiel par Bo Peng.

- SeamlessM4T (de Meta AI) a été publié dans l'article SeamlessM4T — Traduction multimodale et massivement multilingue par l'équipe de communication transparente.

- SeamlessM4Tv2 (de Meta AI) a été publié dans l'article Seamless: Traduction de la parole multilingue, expressive et en continu par l'équipe de communication transparente.

- SegFormer (de NVIDIA) a été publié dans l'article SegFormer : Conception simple et efficace pour la segmentation sémantique avec des transformateurs par Enze Xie, Wenhai Wang, Zhiding Yu, Anima Anandkumar, Jose M. Alvarez, Ping Luo.

- SegGPT (de Beijing Academy of Artificial Intelligence (BAAI) publié dans l'article SegGPT: Segmenting Everything In Context parXinlong Wang, Xiaosong Zhang, Yue Cao, Wen Wang, Chunhua Shen, Tiejun Huang.

- Segment Anything (de Meta AI) a été publié dans l'article Segment Anything par Alexander Kirillov, Eric Mintun, Nikhila Ravi, Hanzi Mao, Chloe Rolland, Laura Gustafson, Tete Xiao, Spencer Whitehead, Alex Berg, Wan-Yen Lo, Piotr Dollar, Ross Girshick.

- SEW (de ASAPP) a été publié dans l'article Compromis entre performances et efficacité dans l'entraînement non supervisé pour la reconnaissance vocale par Felix Wu, Kwangyoun Kim, Jing Pan, Kyu Han, Kilian Q. Weinberger, Yoav Artzi.

- SEW-D (de ASAPP) a été publié dans l'article Compromis entre performances et efficacité dans l'entraînement non supervisé pour la reconnaissance vocale par Felix Wu, Kwangyoun Kim, Jing Pan, Kyu Han, Kilian Q. Weinberger, Yoav Artzi.

- SigLIP (de Google AI) a été publié dans l'article Sigmoid Loss for Language Image Pre-Training par Xiaohua Zhai, Basil Mustafa, Alexander Kolesnikov, Lucas Beyer.

- SpeechT5 (de Microsoft Research) a été publié dans l'article SpeechT5 : Pré-entraînement unifié encodeur-décodeur pour le traitement du langage parlé par Junyi Ao, Rui Wang, Long Zhou, Chengyi Wang, Shuo Ren, Yu Wu, Shujie Liu, Tom Ko, Qing Li, Yu Zhang, Zhihua Wei, Yao Qian, Jinyu Li, Furu Wei.

- SpeechToTextTransformer (de Facebook), publié dans l'article fairseq S2T : Modélisation rapide de la parole à texte avec fairseq par Changhan Wang, Yun Tang, Xutai Ma, Anne Wu, Dmytro Okhonko, Juan Pino.

- SpeechToTextTransformer2 (de Facebook), publié dans l'article Apprentissage auto-supervisé et semi-supervisé à grande échelle pour la traduction de la parole par Changhan Wang, Anne Wu, Juan Pino, Alexei Baevski, Michael Auli, Alexis Conneau.

- Splinter (de l'Université de Tel Aviv), publié dans l'article Réponse à quelques questions avec peu d'exemples par la pré-sélection des spans par Ori Ram, Yuval Kirstain, Jonathan Berant, Amir Globerson, Omer Levy.

- SqueezeBERT (de Berkeley) a été publié dans l'article SqueezeBERT : Que l'apprentissage automatique peut-il apprendre au traitement du langage naturel sur les réseaux neuronaux efficaces ? par Forrest N. Iandola, Albert E. Shaw, Ravi Krishna et Kurt W. Keutzer.

- StableLm (from Stability AI) released with the paper StableLM 3B 4E1T (Technical Report) by Jonathan Tow, Marco Bellagente, Dakota Mahan, Carlos Riquelme Ruiz, Duy Phung, Maksym Zhuravinskyi, Nathan Cooper, Nikhil Pinnaparaju, Reshinth Adithyan, and James Baicoianu.

- Starcoder2 (from BigCode team) released with the paper StarCoder 2 and The Stack v2: The Next Generation by Anton Lozhkov, Raymond Li, Loubna Ben Allal, Federico Cassano, Joel Lamy-Poirier, Nouamane Tazi, Ao Tang, Dmytro Pykhtar, Jiawei Liu, Yuxiang Wei, Tianyang Liu, Max Tian, Denis Kocetkov, Arthur Zucker, Younes Belkada, Zijian Wang, Qian Liu, Dmitry Abulkhanov, Indraneil Paul, Zhuang Li, Wen-Ding Li, Megan Risdal, Jia Li, Jian Zhu, Terry Yue Zhuo, Evgenii Zheltonozhskii, Nii Osae Osae Dade, Wenhao Yu, Lucas Krauß, Naman Jain, Yixuan Su, Xuanli He, Manan Dey, Edoardo Abati, Yekun Chai, Niklas Muennighoff, Xiangru Tang, Muhtasham Oblokulov, Christopher Akiki, Marc Marone, Chenghao Mou, Mayank Mishra, Alex Gu, Binyuan Hui, Tri Dao, Armel Zebaze, Olivier Dehaene, Nicolas Patry, Canwen Xu, Julian McAuley, Han Hu, Torsten Scholak, Sebastien Paquet, Jennifer Robinson, Carolyn Jane Anderson, Nicolas Chapados, Mostofa Patwary, Nima Tajbakhsh, Yacine Jernite, Carlos Muñoz Ferrandis, Lingming Zhang, Sean Hughes, Thomas Wolf, Arjun Guha, Leandro von Werra, and Harm de Vries.

- SwiftFormer (de MBZUAI) a été publié dans l'article SwiftFormer : Attention additive efficace pour les applications de vision mobile en temps réel basées sur des transformateurs par Abdelrahman Shaker, Muhammad Maaz, Hanoona Rasheed, Salman Khan, Ming-Hsuan Yang, Fahad Shahbaz Khan.

- Swin Transformer (de Microsoft) a été publié dans l'article Swin Transformer : Transformateur hiérarchique de la vision utilisant des fenêtres décalées par Ze Liu, Yutong Lin, Yue Cao, Han Hu, Yixuan Wei, Zheng Zhang, Stephen Lin, Baining Guo.

- Swin Transformer V2 (de Microsoft) a été publié dans l'article Swin Transformer V2 : Augmentation de la capacité et de la résolution par Ze Liu, Han Hu, Yutong Lin, Zhuliang Yao, Zhenda Xie, Yixuan Wei, Jia Ning, Yue Cao, Zheng Zhang, Li Dong, Furu Wei, Baining Guo.

- Swin2SR (de l'Université de Würzburg) a été publié dans l'article Swin2SR : Transformateur SwinV2 pour la super-résolution et la restauration d'images compressées par Marcos V. Conde, Ui-Jin Choi, Maxime Burchi, Radu Timofte.

- SwitchTransformers (de Google) a été publié dans l'article Switch Transformers : Passage à des modèles de trillions de paramètres avec une parcimonie simple et efficace par William Fedus, Barret Zoph, Noam Shazeer.

- T5 (de Google AI) a été publié dans l'article Exploration des limites de l'apprentissage par transfert avec un transformateur de texte à texte unifié par Colin Raffel, Noam Shazeer, Adam Roberts, Katherine Lee, Sharan Narang, Michael Matena, Yanqi Zhou, Wei Li et Peter J. Liu.

- T5v1.1 (de Google AI) a été publié dans le dépôt google-research/text-to-text-transfer-transformer par Colin Raffel, Noam Shazeer, Adam Roberts, Katherine Lee, Sharan Narang, Michael Matena, Yanqi Zhou, Wei Li et Peter J. Liu.

- Table Transformer (de Microsoft Research) a été publié dans l'article PubTables-1M : Vers une extraction complète des tables à partir de documents non structurés par Brandon Smock, Rohith Pesala, Robin Abraham.

- TAPAS (de Google AI) a été publié dans l'article TAPAS : Analyse faiblement supervisée des tables via le pré-entraînement par Jonathan Herzig, Paweł Krzysztof Nowak, Thomas Müller, Francesco Piccinno et Julian Martin Eisenschlos.

- TAPEX (de Microsoft Research) a été publié dans l'article TAPEX : Pré-entraînement des tables via l'apprentissage d'un exécuteur SQL neuronal par Qian Liu, Bei Chen, Jiaqi Guo, Morteza Ziyadi, Zeqi Lin, Weizhu Chen et Jian-Guang Lou.

- Time Series Transformer (de HuggingFace).

- TimeSformer (de Facebook) a été publié dans l'article Is Space-Time Attention All You Need for Video Understanding? par Gedas Bertasius, Heng Wang, Lorenzo Torresani.

- Trajectory Transformer (de l'Université de Californie à Berkeley) a été publié dans l'article L'apprentissage par renforcement hors ligne comme un grand problème de modélisation de séquence par Michael Janner, Qiyang Li, Sergey Levine.

- Transformer-XL (de Google/CMU) a été publié dans l'article Transformer-XL : Modèles de langage attentifs au-delà d'un contexte de longueur fixe par Zihang Dai*, Zhilin Yang*, Yiming Yang, Jaime Carbonell, Quoc V. Le, Ruslan Salakhutdinov.

- TrOCR (de Microsoft), publié dans l'article TrOCR : Reconnaissance optique de caractères basée sur un transformateur avec des modèles pré-entraînés par Minghao Li, Tengchao Lv, Lei Cui, Yijuan Lu, Dinei Florencio, Cha Zhang, Zhoujun Li, Furu Wei.

- TVLT (de l'UNC Chapel Hill) a été publié dans l'article TVLT : Transformer Vision-Language sans texte par Zineng Tang, Jaemin Cho, Yixin Nie, Mohit Bansal.

- TVP (d'Intel) a été publié dans l'article Text-Visual Prompting for Efficient 2D Temporal Video Grounding par Yimeng Zhang, Xin Chen, Jinghan Jia, Sijia Liu, Ke Ding.

- UDOP (de Microsoft Research) publié dans l'article Unifying Vision, Text, and Layout for Universal Document Processing parZineng Tang, Ziyi Yang, Guoxin Wang, Yuwei Fang, Yang Liu, Chenguang Zhu, Michael Zeng, Cha Zhang, Mohit Bansal.

- UL2 (de Google Research) a été publié dans l'article Unifying Language Learning Paradigms par Yi Tay, Mostafa Dehghani, Vinh Q. Tran, Xavier Garcia, Dara Bahri, Tal Schuster, Huaixiu Steven Zheng, Neil Houlsby, Donald Metzler.

- UMT5 (de Google Research) a été publié dans l'article UniMax : Échantillonnage linguistique plus équitable et plus efficace pour l'entraînement préalable multilingue à grande échelle par Hyung Won Chung, Xavier Garcia, Adam Roberts, Yi Tay, Orhan Firat, Sharan Narang, Noah Constant.

- UniSpeech (de Microsoft Research) a été publié dans l'article UniSpeech : Apprentissage unifié de la représentation de la parole avec des données étiquetées et non étiquetées par Chengyi Wang, Yu Wu, Yao Qian, Kenichi Kumatani, Shujie Liu, Furu Wei, Michael Zeng, Xuedong Huang.

- UniSpeechSat (de Microsoft Research) a été publié dans l'article UNISPEECH-SAT : Apprentissage universel de la représentation de la parole avec la préformation consciente du locuteur par Sanyuan Chen, Yu Wu, Chengyi Wang, Zhengyang Chen, Zhuo Chen, Shujie Liu, Jian Wu, Yao Qian, Furu Wei, Jinyu Li, Xiangzhan Yu.

- UnivNet (de Kakao Corporation) a été publié dans l'article UnivNet : un vocodeur neuronal avec des discriminateurs de spectrogramme multi-résolution pour la génération de formes d'onde haute fidélité par Won Jang, Dan Lim, Jaesam Yoon, Bongwan Kim et Juntae Kim.

- UPerNet (de l'Université de Pékin) a été publié dans l'article Analyse perceptuelle unifiée pour la compréhension de scènes par Tete Xiao, Yingcheng Liu, Bolei Zhou, Yuning Jiang, Jian Sun.

- VAN (de l'Université Tsinghua et de l'Université Nankai) publié dans l'article Visual Attention Network par Meng-Hao Guo, Cheng-Ze Lu, Zheng-Ning Liu, Ming-Ming Cheng, Shi-Min Hu.

- VideoMAE (du groupe d'informatique multimédia, Université de Nankin) publié dans l'article VideoMAE : Les autoencodeurs masqués sont des apprenants efficaces en données pour l'auto-pré-entraînement vidéo supervisé par Zhan Tong, Yibing Song, Jue Wang, Limin Wang.

- ViLT (du NAVER AI Lab/Kakao Enterprise/Kakao Brain) publié dans l'article ViLT : Vision-and-Language Transformer sans convolution ni supervision de région par Wonjae Kim, Bokyung Son, Ildoo Kim.

- VipLlava (de l'Université du Wisconsin–Madison) publié dans l'article Rendre les grands modèles multimodaux comprenant des incitations visuelles arbitraires par Mu Cai, Haotian Liu, Siva Karthik Mustikovela, Gregory P. Meyer, Yuning Chai, Dennis Park, Yong Jae Lee.

- Vision Transformer (ViT) (de Google AI) publié dans l'article Une image vaut 16x16 mots : Transformers pour la reconnaissance d'images à grande échelle par Alexey Dosovitskiy, Lucas Beyer, Alexander Kolesnikov, Dirk Weissenborn, Xiaohua Zhai, Thomas Unterthiner, Mostafa Dehghani, Matthias Minderer, Georg Heigold, Sylvain Gelly, Jakob Uszkoreit, Neil Houlsby.

- VisualBERT (de UCLA NLP) publié dans l'article VisualBERT : Une référence simple et performante pour la vision et le langage par Liunian Harold Li, Mark Yatskar, Da Yin, Cho-Jui Hsieh, Kai-Wei Chang.

- ViT Hybrid (de Google AI) publié dans l'article Une image vaut 16x16 mots : Transformers pour la reconnaissance d'images à grande échelle par Alexey Dosovitskiy, Lucas Beyer, Alexander Kolesnikov, Dirk Weissenborn, Xiaohua Zhai, Thomas Unterthiner, Mostafa Dehghani, Matthias Minderer, Georg Heigold, Sylvain Gelly, Jakob Uszkoreit, Neil Houlsby.

- VitDet (de Meta AI) publié dans l'article Exploration des transformateurs de vision plain pour la détection d'objets par Yanghao Li, Hanzi Mao, Ross Girshick, Kaiming He.

- ViTMAE (de Meta AI) publié dans l'article Les autoencodeurs masqués sont des apprenants évolutifs de la vision par Kaiming He, Xinlei Chen, Saining Xie, Yanghao Li, Piotr Dollár, Ross Girshick.

- ViTMatte (de HUST-VL) publié dans l'article ViTMatte : Renforcer le détourage d'image avec des transformateurs de vision plain pré-entraînés par Jingfeng Yao, Xinggang Wang, Shusheng Yang, Baoyuan Wang.

- ViTMSN (de Meta AI) publié dans l'article Masked Siamese Networks for Label-Efficient Learning par Mahmoud Assran, Mathilde Caron, Ishan Misra, Piotr Bojanowski, Florian Bordes, Pascal Vincent, Armand Joulin, Michael Rabbat, Nicolas Ballas.

- VITS (de Kakao Enterprise) publié dans l'article Auto-encodeur variationnel conditionnel avec apprentissage adversarial pour la conversion texte-parole de bout en bout par Jaehyeon Kim, Jungil Kong, Juhee Son.

- ViViT (de Google Research) publié dans l'article ViViT : Un transformateur de vision vidéo par Anurag Arnab, Mostafa Dehghani, Georg Heigold, Chen Sun, Mario Lučić, Cordelia Schmid.

- Wav2Vec2 (de Facebook AI) publié dans l'article wav2vec 2.0 : Un cadre pour l'apprentissage auto-supervisé des représentations de la parole par Alexei Baevski, Henry Zhou, Abdelrahman Mohamed, Michael Auli.

- Wav2Vec2-BERT (de Meta AI) publié dans l'article Seamless : Traduction de la parole multilingue, expressive et en continu par l'équipe Seamless Communication.

- Wav2Vec2-Conformer (de Facebook AI) a été publié dans l'article FAIRSEQ S2T : Modélisation rapide de la parole au texte avec FAIRSEQ par Changhan Wang, Yun Tang, Xutai Ma, Anne Wu, Sravya Popuri, Dmytro Okhonko, Juan Pino.

- Wav2Vec2Phoneme (de Facebook AI) a été publié dans l'article Reconnaissance de phonèmes interlingues simple et efficace sans apprentissage préalable par Qiantong Xu, Alexei Baevski, Michael Auli.

- WavLM (de Microsoft Research) a été publié dans l'article WavLM : Pré-entraînement auto-supervisé à grande échelle pour le traitement complet de la parole par Sanyuan Chen, Chengyi Wang, Zhengyang Chen, Yu Wu, Shujie Liu, Zhuo Chen, Jinyu Li, Naoyuki Kanda, Takuya Yoshioka, Xiong Xiao, Jian Wu, Long Zhou, Shuo Ren, Yanmin Qian, Yao Qian, Jian Wu, Michael Zeng, Furu Wei.

- Whisper (d'OpenAI) a été publié dans l'article Reconnaissance robuste de la parole via une supervision faible à grande échelle par Alec Radford, Jong Wook Kim, Tao Xu, Greg Brockman, Christine McLeavey, Ilya Sutskever.

- X-CLIP (de Microsoft Research) a été publié dans l'article Expansion des modèles pré-entraînés langage-image pour la reconnaissance vidéo générale par Bolin Ni, Houwen Peng, Minghao Chen, Songyang Zhang, Gaofeng Meng, Jianlong Fu, Shiming Xiang, Haibin Ling.

- X-MOD (de Meta AI) a été publié dans l'article Lever le sort de la multilinguité par le pré-entraînement des transformateurs modulaires par Jonas Pfeiffer, Naman Goyal, Xi Lin, Xian Li, James Cross, Sebastian Riedel, Mikel Artetxe.

- XGLM (de Facebook AI) a été publié dans l'article Apprentissage à quelques échantillons avec des modèles de langues multilingues par Xi Victoria Lin, Todor Mihaylov, Mikel Artetxe, Tianlu Wang, Shuohui Chen, Daniel Simig, Myle Ott, Naman Goyal, Shruti Bhosale, Jingfei Du, Ramakanth Pasunuru, Sam Shleifer, Punit Singh Koura, Vishrav Chaudhary, Brian O'Horo, Jeff Wang, Luke Zettlemoyer, Zornitsa Kozareva, Mona Diab, Veselin Stoyanov, Xian Li.

- XLM (de Facebook) a été publié dans l'article Pré-entraînement de modèles linguistiques multilingues par Guillaume Lample et Alexis Conneau.

- XLM-ProphetNet (de Microsoft Research) a été publié dans l'article ProphetNet : Prédire l'avenir N-gramme pour le pré-entraînement séquence-séquence par Yu Yan, Weizhen Qi, Yeyun Gong, Dayiheng Liu, Nan Duan, Jiusheng Chen, Ruofei Zhang et Ming Zhou.

- XLM-RoBERTa (de Facebook AI), publié dans l'article Apprentissage non supervisé de la représentation croisée-lingue à grande échelle par Alexis Conneau*, Kartikay Khandelwal*, Naman Goyal, Vishrav Chaudhary, Guillaume Wenzek, Francisco Guzmán, Edouard Grave, Myle Ott, Luke Zettlemoyer et Veselin Stoyanov.

- XLM-RoBERTa-XL (de Facebook AI), publié dans l'article Transformateurs à plus grande échelle pour la modélisation du langage masqué multilingue par Naman Goyal, Jingfei Du, Myle Ott, Giri Anantharaman, Alexis Conneau.

- XLM-V (de Meta AI) a été publié dans l'article XLM-V : Surmonter le goulot d'étranglement du vocabulaire dans les modèles de langage masqués multilingues par Davis Liang, Hila Gonen, Yuning Mao, Rui Hou, Naman Goyal, Marjan Ghazvininejad, Luke Zettlemoyer, Madian Khabsa.

- XLNet (de Google/CMU) a été publié dans l'article XLNet : Préentraînement autorégressif généralisé pour la compréhension du langage par Zhilin Yang*, Zihang Dai*, Yiming Yang, Jaime Carbonell, Ruslan Salakhutdinov, Quoc V. Le.

- XLS-R (de Facebook AI) publié dans l'article XLS-R : Apprentissage d'une représentation de la parole autonome et multilingue à grande échelle par Arun Babu, Changhan Wang, Andros Tjandra, Kushal Lakhotia, Qiantong Xu, Naman Goyal, Kritika Singh, Patrick von Platen, Yatharth Saraf, Juan Pino, Alexei Baevski, Alexis Conneau, Michael Auli.

- XLSR-Wav2Vec2 (de Facebook AI) publié dans l'article Apprentissage non supervisé de représentations multilingues pour la reconnaissance vocale par Alexis Conneau, Alexei Baevski, Ronan Collobert, Abdelrahman Mohamed, Michael Auli.

- YOLOS (de l'Université Huazhong des sciences et technologies) publié dans l'article You Only Look at One Sequence : Repenser le Transformer dans la vision à travers la détection d'objets par Yuxin Fang, Bencheng Liao, Xinggang Wang, Jiemin Fang, Jiyang Qi, Rui Wu, Jianwei Niu, Wenyu Liu.

- YOSO (de l'Université du Wisconsin - Madison) publié dans l'article You Only Sample (Almost) Once : Coût linéaire Self-Attention via l'échantillonnage Bernoulli par Zhanpeng Zeng, Yunyang Xiong, Sathya N. Ravi, Shailesh Acharya, Glenn Fung, Vikas Singh.

- Vous souhaitez contribuer avec un nouveau modèle ? Nous avons ajouté un guide détaillé et des modèles types pour vous guider dans le processus d'ajout d'un nouveau modèle. Vous pouvez les trouver dans le dossier

templatesdu référentiel. Assurez-vous de consulter les directives de contribution et de contacter les mainteneurs ou d'ouvrir un ticket pour recueillir des commentaires avant de commencer votre pull request.

Pour vérifier si chaque modèle a une implémentation en Flax, PyTorch ou TensorFlow, ou s'il a un tokenizer associé pris en charge par la bibliothèque 🤗 Tokenizers, consultez ce tableau.

Ces implémentations ont été testées sur plusieurs ensembles de données (voir les scripts d'exemple) et devraient correspondre aux performances des implémentations originales. Vous pouvez trouver plus de détails sur les performances dans la section Exemples de la documentation.

| Section | Description |

|---|---|

| Documentation | Documentation complète de l'API et tutoriels |

| Résumé des tâches | Tâches prises en charge par les 🤗 Transformers |

| Tutoriel de prétraitement | Utilisation de la classe Tokenizer pour préparer les données pour les modèles |

| Entraînement et ajustement fin | Utilisation des modèles fournis par les 🤗 Transformers dans une boucle d'entraînement PyTorch/TensorFlow et de l'API Trainer |

| Tour rapide : Scripts d'ajustement fin/d'utilisation | Scripts d'exemple pour ajuster finement les modèles sur une large gamme de tâches |

| Partage et téléversement de modèles | Téléchargez et partagez vos modèles ajustés avec la communauté |

Nous disposons désormais d'un article que vous pouvez citer pour la bibliothèque 🤗 Transformers :

@inproceedings{wolf-etal-2020-transformers,

title = "Transformers: State-of-the-Art Natural Language Processing",

author = "Thomas Wolf and Lysandre Debut and Victor Sanh and Julien Chaumond and Clement Delangue and Anthony Moi and Pierric Cistac and Tim Rault and Rémi Louf and Morgan Funtowicz and Joe Davison and Sam Shleifer and Patrick von Platen and Clara Ma and Yacine Jernite and Julien Plu and Canwen Xu and Teven Le Scao and Sylvain Gugger and Mariama Drame and Quentin Lhoest and Alexander M. Rush",

booktitle = "Proceedings of the 2020 Conference on Empirical Methods in Natural Language Processing: System Demonstrations",

month = oct,

year = "2020",

address = "Online",

publisher = "Association for Computational Linguistics",

url = "https://www.aclweb.org/anthology/2020.emnlp-demos.6",

pages = "38--45"

}